Οι Google δέχεται μεγάλη επίθεση από το μεγαλύτερο μέρος των χρηστών της, αφού η τεχνητή νοημοσύνη που αναπτύσσει την γελοιοποιεί κάθε μέρα όλο και περισσότερο. Με το AI Overviews να κυκλοφορεί ήδη στις ΗΠΑ, το κοινό παίρνει απαντήσεις που είναι εντελώς λανθασμένες και αρκετές φορές επικίνδυνες, όπως η απάντηση που έδωσε εχθές, πως πρέπει να βάζουμε κόλλα στην πίτσα για να μην γλιστράει το τυρί.

Η μηχανή τεχνητής νοημοσύνης Gemini 1.5, που ήρθε να ανταγωνιστεί το ChatGPT της Open AI, τα έχει κάνει μαντάρα και τώρα όλος ο κόσμος στις ΗΠΑ το βλέπει. Όχι βέβαια πως το ChatGPT είναι καλύτερο, αφού και αυτό έχει τις ίδιες παθογένειες, όμως τουλάχιστον εκείνο μέχρι στιγμής δεν επιβάλλεται στον κόσμο με το έτσι θέλω, όπως γίνεται με την υλοποίηση της Google, που προσπαθεί να βάλει το Gemini κυριολεκτικά παντού. Όταν η τεχνητή νοημοσύνη της Google δίνει λανθασμένες, εκνευριστικές, γελοίες και επικίνδυνες απαντήσεις, τότε σίγουρα κάτι δεν πάει καλά με τον κολοσσό. Σύμφωνα με τις πληροφορίες από την άλλη άκρη του Ατλαντικού, η τεχνητή νοημοσύνη στην μηχανή αναζήτησης της Google, δεν μπορεί να διακρίνει την πληροφορία από την σάτιρα, τον σαρκασμό και την πλάκα.

Το διαδίκτυο έχει γεμίσει με τις ανόητες απαντήσεις που δίνει η Google. Εκτός από την χρήση κόλλας στην πίτσα, έχουμε δει συμβουλές για όσους έχουν νεφρική ανεπάρκεια, που περιλαμβάνουν την κατανάλωση 2 λίτρων ούρων την ημέρα. Σε αλλες ερωτήσεις η Google υποστηρίζει πως τα σκυλιά παίζουν μπάσκετ και μάλιστα στο NBA, αλλά και αμερικάνικο ποδόσφαιρο.

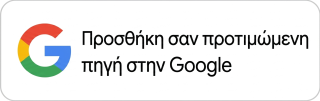

Όμως έχει κραυγαλέα λάθη και σε πιο σημαντικές απαντήσεις που δίνει. Για παράδειγμα, παρουσιάζει τον Ομπάμα σαν τον πρώτο μουσουλμάνο πρόεδρο των ΗΠΑ. Αυτό σημβαίνει γιατί η τεχνητή νοημοσύνη συγκεντρώνει τα δεδομένα της από όλο το διαδίκτυο, συμπεριλαμβάνοντας σελίδες σάτιρας ή troll σχόλια σε forums και στο Reddit. Όμως όταν παρουσιάζει σαν πραγματικότητα της αναρτήσεις του σατιρικού ιστότοπου «The Onion» (κάτι σαν το δικό μας κουλούρι), τότε τα πράγματα γίνονται περίπλοκα και επικίνδυνα. Μάλιστα, σε απάντηση που δόθηκε, συνιστούσε στον κόσμο να τρώει ένα μικρό πετραδάκι την ημέρα.

Η Google ισχυρίζεται πως τα σφάλματα οφείλονται σε πολύ ασυνήθιστα αιτήματα και δεν είναι αυτό που κάνει η πλειοψηφία του κόσμου και πως αυτά είναι μεμονωμένα περιστατικά. Όμως αυτές οι απαντήσεις που έχουμε δει μέχρι σήμερα, δεν είναι σε περίεργα ερωτήματα, αλλά αιτήματα που έχουν να κάνουν με την καθημερινότητά μας και την υγεία μας.

Αυτό είναι Galaxy Watch 7 Ultra και μας κάνει να αναρωτιόμαστε: Τι σκεφτόταν η Samsung;

Δεν είναι η πρώτη φορά που η Google τα κάνει μαντάρα. Τον Φεβρουάριο, το Gemini δημιουργούσε εικόνες, βασιζόμενο στην Woke κουλτούρα, με μαύρους και κινέζους στρατιώτες των ναζί, με κινέζο Μέγα Αλέξανδρο και μαύρους Έλληνες, αλλά και κινέζους Αιγύπτιους. Η Google απέτυχε στο να ορίσει σωστά πότε η διαφορετικότητα είναι ακατάλληλη και ακόμα και σήμερα, η δυνατότητα δημιουργίας εικόνων με ανθρώπους, δεν έχει επανέλθει. Μάλλον το πρόβλημα δεν ήταν τόσο απλό.

Το σίγουρο είναι πως η Google γελοιοποιείται μέρα με την μέρα, στην προσπάθειά της να πάρει ένα κομμάτι από την πίτα της τεχνητής νοημοσύνης, όσο πιο γρήγορα γίνεται. Αυτό θα είναι και το Βατερλό της, όπως σας είπαμε εχθές σε άρθρο.

Ακολουθήστε το Techmaniacs.gr στο Google News για να διαβάζετε πρώτοι όλα τα τεχνολογικά νέα. Ένας ακόμα τρόπος να μαθαίνετε τα πάντα πρώτοι είναι να προσθέσετε το Techmaniacs.gr στον RSS feeder σας χρησιμοποιώντας τον σύνδεσμο: https://techmaniacs.gr/feed/.

![Ανθρώπινα εγκεφαλικά κύτταρα σε chip κατάφεραν να παίξουν Doom! [Βίντεο] CL1](https://techmaniacs.gr/wp-content/uploads/2025/07/maxresdefault-218x150.jpg)

![Samsung Galaxy S26 Ultra Review: Είναι τελικά Ultra; [Βίντεο] Galaxy S26 ultra review](https://techmaniacs.gr/wp-content/uploads/2026/03/Galaxy-S26-ultra-review-218x150.webp)