Όταν οι εταιρείες ξεκίνησαν να προωθούν την τεχνητή νοημοσύνη, μας έλεγαν πως θα αλλάξει τον κόσμο και πως θα θεραπεύσει σοβαρές ασθένειες, όμως η πραγματικότητα, ακόμα και τώρα, είναι αρκετά διαφορετική από αυτού που μας υποσχέθηκαν. Πλέον το κοινό χρησιμοποιεί την τεχνητή νοημοσύνη για τη δημιουργία εικόνων και βίντεο, ενώ εκτός από τον κώδικα που μπορεί να γράψει αρκετά αποδοτικά, η τεχνητή νοημοσύνη χρησιμοποιείται και για παραγωγή κειμένων από πολλά μέσα, το οποίο όμως περιέχει αρκετές ανακρίβειες και λάθη. Όμως, εκτός από αυτές τις χρήσεις, τα μεγάλα γλωσσικά μοντέλα, έχουν ήδη ξεκινήσει την δημιουργία bots τεχνητής νοημοσύνης σε αυτό που αποκαλούμε σμήνη, για διάφορές όχι και τόσο θετικές λειτουργίες.

Τι είναι τα σμήνη από Bots τεχνητής νοημοσύνης;

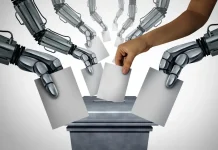

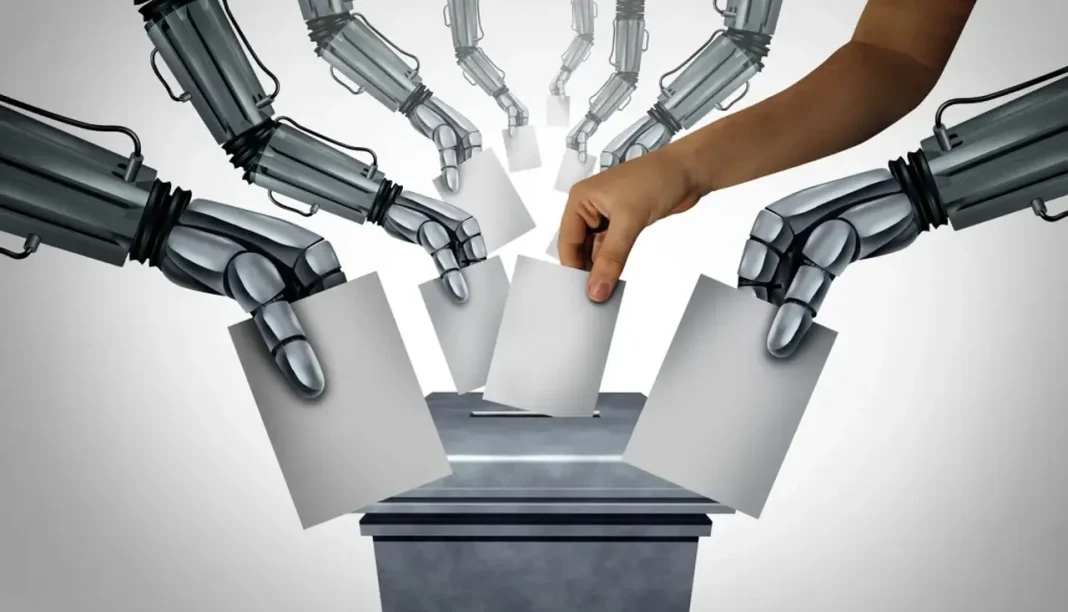

Σύμφωνα με νέα μελέτη, αυτά τα σμήνη από bots, χρησιμοποιείται για την χειραγώγηση των πεποιθήσεων του κοινού, κάτι που με τι σειρά του αποτελεί σοβαρή απειλή για την δημοκρατία, παγκοσμίως. Αυτά τα bots μιμούνται πραγματικούς χρήστες και παράγουν σχόλια και δημοσιεύσεις αυτοματοποιημένα, ώστε να δείξει μαζικότητα προς μία άποψη, όταν αυτή δεν υπάρχει. Το έχουμε δει και στην χώρα μας, ιδιαίτερα σε θέματα πολιτικής, με στρατιές από bots να αφήνουν σχόλια στα μέσα κοινωνικής δικτύωσης, επαινώντας ορισμένες απόψεις και κατακρίνοντας άλλες.

Με τα νέα bots τεχνητής νοημοσύνης όμως, έχουμε ένα νέο επίπεδο διασποράς παραπληροφόρησης. Τα παραδοσιακά botnets ήταν σχεδιασμένα για να αναπαράγουν συγκεκριμένα σχόλια που ήταν προκαθορισμένα, σε όλο το διαδίκτυο. Τώρα, τα AI Bots μπορούν να κατανοήσουν το θέμα και να απαντήσουν σαν πραγματικοί άνθρωποι, ακολουθώντας όμως την ρητορική αυτού που τα προγραμμάτισε.

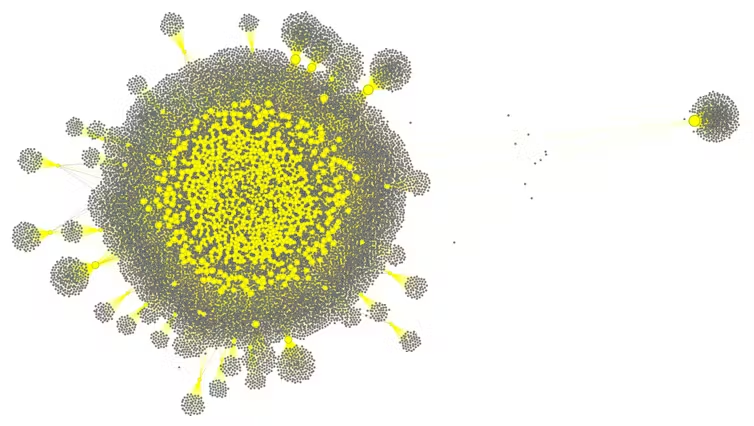

Τώρα όμως, έχουμε και τα σμήνη τεχνητής νοημοσύνης, που είναι στην ουσία συνεργατικά δίκτυα αυτόνομων AI Agents, που δρουν αυτόνομα, σαρώνοντας το διαδίκτυο για συγκεκριμένα θέματα και απαντώντας σαν πραγματικοί άνθρωποι. Αυτό μπορεί να δημιουργήσει την αίσθηση της μαζικότητας για ένα θέμα. Έτσι, μπορούν να κάνουν τα σχόλια σε όλο το διαδίκτυο να φαίνονται σαν ο κόσμος να κατακρίνει μια πολιτική ή πως συμφωνεί μαζί της, κάτι που πρακτικά είναι ένα μέσω παραπληροφόρησης.

Αυτά τα σμήνη ελέγχονται μαζικά, κατά χιλιάδες. Δημιουργούν διαφορετικά αληθοφανή προφίλ και συνεργάζονται μεταξύ τους. Με αυτό τον τρόπο μπορούν να πραγματοποιήσουν συντονισμένες επιχειρήσεις ή και λεκτικές επιθέσεις σε συγκεκριμένα άτομα και οργανισμούς.

Τα μοντέλα που χρησιμοποιούν, πραγματοποιούν μια χαρτογράφηση στα κοινωνικά δίκτυα, ώστε να εντοπίσουν ομάδες και κοινότητες, ώστε να στοχοποιήσουν συγκεκριμένες ομάδες ανθρώπων. Στη συνέχεια, με λεκτικό σαν πραγματικού ανθρώπου, ξεκινούν να σχολιάζουν υπέρ ή κατά συγκεκριμένων απόψεων και καταστάσεων. Μάλιστα, οι απαντήσεις τους περιέχουν τοπική αργκό και διάφορά άλλα πολιτισμικά χαρακτηριστικά, ώστε να είναι σχεδόν αδύνατο να τα ξεχωρίσουν οι χρήστες.

Σε αντίθεση με τα παλιά botnets, δεν επαναλαμβάνουν ποτέ το ίδιο κείμενο και δεν εμφανίζουν διακριτά μοτίβα, ενώ πολλές φορές δημιουργούν φωτογραφίες ιδιαίτερα αληθοφανείς, ώστε να φαίνονται σαν πραγματικοί χρήστες.

Ταυτόχρονα, τρέχουν πολλές δοκιμές στο κοινό που απευθύνονται, μετρώντας την αποδοτικότητά τους, ώστε να βρουν το καλύτερο δυνατό αφήγημα για να περάσουν στο κοινό αυτά που έχουν θέσει σαν στόχο οι δημιουργοί τους.

Συνθετική συναίνεση

Ήδη έχουν παρατηρηθεί και προσομοιωθεί φαινόμενα, που ένα σμήνος από bots τεχνητής νοημοσύνης, έχουν δημιουργήσει λογαριασμούς σε μέσα κοινωνικής δικτύωσης, τα οποία χρησιμοποιούσαν διαφορετικές τακτικές για να επηρεάσουν την κοινότητα που έχουν βάλει στόχο. Μία τακτική ήταν μακράν η πιο αποτελεσματική: η διείσδυση. Μόλις μια διαδικτυακή ομάδα διεισδύσει, κακόβουλα σμήνη τεχνητής νοημοσύνης μπορούν να δημιουργήσουν την ψευδαίσθηση ευρείας δημόσιας συμφωνίας σχετικά με τις αφηγήσεις που έχουν προγραμματιστεί να προωθήσουν. Κοινώς, δημιουργούν το αίσθημα πως η μεγαλύτερη μερίδα του κοινού έχει μια άποψη, εκμεταλλευόμενοι ένα γνωστό ψυχολογικό φαινόμενο, γνωστό και ως κοινωνική απόδειξη. Σύμφωνα με αυτό οι άνθρωποι έχουν τη φυσική τάση να πιστεύουν κάτι αν αντιληφθούν ότι «όλοι το λένε.

Ακόμα και αν ένας πραγματικός χρήστης καταρρίψει όλα τα επιχειρήματα που γράφουν τα AI Bots, έρχεται ένα σμήνος από εικονικούς χρήστες, συντονίζοντας της φωνές του, ώστε να βγάλουν τον χρήστη τρελό ή λάθος με έναν πολύ ρεαλιστικό τρόπο. Αυτό δημιουργεί και μια σειρά από followers στους ψεύτικους λογαριασμούς, οι οποίοι προσομοιώνουν και την δραστηριότητα ενός πραγματικούς χρήστη, κάνοντας αναρτήσεις και σχόλια και για άλλα θέματα, όπως ένας αγώνας ή μια ταινία, στοχεύοντας κυρίως σε ενδιαφέροντα που έχουν οι χρήστες τους οποίους στοχεύουν.

Όλα αυτά αποτελούν τεράστια απειλή για την δημόσια σφαίρα και τους δημοκρατικούς μηχανισμούς, όπου ο κάθε άνθρωπος εκφράζει τις απόψεις του και κάνει εποικοδομητικό διάλογο με τους συνανθρώπους του. Αυτές οι συζητήσεις μεταξύ ανθρώπων διαμορφώνουν και κοινές πεποιθήσεις, όπως επίσης και καθορίζουν αποφάσεις. Εάν οι πολίτες δεν μπορούν να διακρίνουν αξιόπιστα μεταξύ της γνήσιας δημόσιας γνώμης και της αλγοριθμικά παραγόμενης προσομοίωσης ομοφωνίας, η δημοκρατική λήψη αποφάσεων θα μπορούσε να υπονομευθεί σοβαρά.

Υπάρχει τρόπος άμυνας ενάντια στα Bots τεχνητής νοημοσύνης;

Στην παρούσα φάση δεν υπάρχει καμία λύση για αυτό το πρόβλημα. Τα σμήνη από bots τεχνητής νοημοσύνης είναι τόσο μεγάλα και χαώδη, που δύσκολα μπορεί να γίνει μια πρόβλεψη για τον κίνδυνο που ενέχουν. Αυτά τα bots είναι τόσο ρεαλιστικά, που είναι σχεδόν αδύνατο να καταλάβει ένας χρήστης πως πίσω από το προφίλ τους, δεν βρίσκεται ένας πραγματικός άνθρωπος.

Η περίπτωση ειδοποίησης που δεν περιμένεις στο Gov.gr Wallet

Οι επιστήμονες και οι μηχανικοί προσπαθούν να αναπτύξουν εργαλεία που θα ανιχνεύουν μοτίβα συντονισμένης συμπεριφορά, που να διαφέρει από την ανθρώπινη αλληλεπίδραση, όμως ακόμα και αυτό είναι πολύ δύσκολο. Κάθε Bot τεχνητής νοημοσύνης έρχεται με πολύ διαφορετικά χαρακτηριστικά, ενδιαφέροντα και τρόπο ομιλίας, κάτι που τα κάνει πολύ δύσκολο να εντοπιστούν. Ο μόνος τρόπος που θα μπορούσε να γίνει κάτι τέτοιο είναι ίσως η αναγνώριση του συγχρονισμού μεταξύ των bots στο διαδίκτυο, για την προώθηση ενός συγκεκριμένου αφηγήματος.

Οι πλατφόρμες κοινωνικής δικτύωσης θα μπορούσαν να χρησιμοποιήσουν τέτοιες μεθόδους, έχοντας μάλιστα και πλήρη πρόσβαση στα δεδομένα, όμως από την άλλη, τα μοντέλα τεχνητής νοημοσύνης που χρησιμοποιούνται, πιθανότατα είναι αυτά των ίδιων των μέσων ή παρεμφερή. Μια άλλη λύση θα είναι να αναγκάζονται όλα τα γλωσσικά μοντέλα να αναγράφουν στις δημοσιεύσεις τους πως πρόκειται για λόγια ενός bot τεχνητής νοημοσύνης, ώστε να είναι ξεκάθαρο πως πρόκειται για τεχνητό περιεχόμενο. Τέλος, ο περιορισμός της δημιουργίας εσόδων από μη αυθεντική εμπλοκή θα μείωνε τα οικονομικά κίνητρα για τις επιχειρήσεις επιρροής και άλλες κακόβουλες ομάδες να χρησιμοποιούν συνθετική συναίνεση.

Η απειλή των Bots τεχνητής νοημοσύνης είναι εδώ

Όλα αυτά δείχνουν πως η απειλή είναι πραγματική και μπορούν να βάλουν βόμβα στα θεμέλια της ίδιας της δημοκρατίας. Μπορούν να επηρεάσουν πολιτικά και κοινωνικά συστήματα παγκοσμίως και αυτό είναι κάτι που ήδη βλέπουμε και στα ελληνικά δεδομένα.

Την ίδια στιγμή, η κυβέρνηση των ΗΠΑ θέλει να μειώσει τον έλεγχο της τεχνητής νοημοσύνης και των μέσων κοινωνικής δικτύωσης, ώστε να κάνει πιο εύκολη την ανάπτυξη και εκπαίδευση των μοντέλων από αμερικανικές εταιρείες. Με αυτό όμως θα θυσιάσει την ασφάλεια του κοινού, αλλά και την ίδια τη δημοκρατία.

Όλα αυτά δεν είναι θεωρητικά. Μια βόλτα στα μέσα κοινωνικής δικτύωσης θα μας δείξει μαζικά σχόλια υπέρ πολιτικών που είναι απάνθρωπες. Τελευταία, με πολεμικές συρράξεις σε πολλές χώρες, βλέπουμε συντονισμένα σχόλια υπέρ κρατών και πολιτικών προσώπων, τα οποία όμως ασκούν τρομερά βίαιη πολιτική.

Το διαδίκτυο έπρεπε να είναι ένας χώρος ελεύθερης έκφρασης και συζήτησης. Πλέον έχει γίνει ένα μέσω παραπληροφόρησης και προπαγάνδας. Είχαμε τα γνωστά trolls, όμως ξέραμε ποιοι είναι και δεν τους παίρναμε σοβαρά. Τώρα, οποιοδήποτε προφίλ μπορεί να είναι ένα AI Bot με στόχο να χαλιναγωγήσει την κοινή γνώμη για διάφορα θέματα. Όσο η τεχνητή νοημοσύνη αναπτύσσεται, τόσο πιο δύσκολο θα είναι να ξεχωρίσουμε τους πραγματικούς χρήστες από τα bots.

Ακολουθήστε το Techmaniacs.gr στο Google News για να διαβάζετε πρώτοι όλα τα τεχνολογικά νέα. Ένας ακόμα τρόπος να μαθαίνετε τα πάντα πρώτοι είναι να προσθέσετε το Techmaniacs.gr στον RSS feeder σας χρησιμοποιώντας τον σύνδεσμο: https://techmaniacs.gr/feed/.

![Ανθρωποειδές ρομπότ της Honor τρέχει ημιμαραθώνιο και σπάει κάθε ρεκόρ [Βίντεο] Honor ρομπότ](https://techmaniacs.gr/wp-content/uploads/2026/04/Honor-Robot-218x150.webp)

![Samsung Galaxy S26 Ultra Review: Είναι τελικά Ultra; [Βίντεο] Galaxy S26 ultra review](https://techmaniacs.gr/wp-content/uploads/2026/03/Galaxy-S26-ultra-review-218x150.webp)

![Ανθρωποειδές ρομπότ της Honor τρέχει ημιμαραθώνιο και σπάει κάθε ρεκόρ [Βίντεο] Honor ρομπότ](https://techmaniacs.gr/wp-content/uploads/2026/04/Honor-Robot-100x70.webp)

![Ανθρωποειδές ρομπότ της Honor τρέχει ημιμαραθώνιο και σπάει κάθε ρεκόρ [Βίντεο] Honor ρομπότ](https://techmaniacs.gr/wp-content/uploads/2026/04/Honor-Robot-324x160.webp)