Η Google κα η Character.AI συμφώνησαν να διευθετήσουν πολλαπλές αγωγές που έχουν κατατεθεί από οικογένειες των οποίων τα παιδιά αυτοκτόνησαν ή ανέπτυξαν ψυχολογικές βλάβες, που συνδέονται με τα chatbots τεχνητής νοημοσύνης, που ενσωματώνονται στην πλατφόρμα Character.AI. Οι δύο εταιρείες έχουν ήδη συμφωνήσει σε έναν «αρχικό διακανονισμό», όμως οι λεπτομέρειες δεν έχουν ακόμα αποκαλυφθεί.

Πολλές υποθέσεις του Character.AI και όχι μόνο

Οι νομικές αξιώσεις περιλάμβαναν αμέλεια, άδικο θάνατο, παραπλανητικές εμπορικές πρακτικές και ευθύνη προϊόντος. Η πρώτη και μια από τις μεγαλύτερες υποθέσεις, αφορά τον 14χρονο Sewell Setzer III, που έκανε συζητήσεις με ένα chatbot του Game of Thrones που υπάρχει στην πλατφόρμα. Οι συζητήσεις έγιναν σεξουαλικές, ενώ οδήγησαν τον έφηβο στο να πάρει την ίδια του τη ζωή. Σε μια άλλη υπόθεση, ένας 17χρονος λάμβανε προτροπές για να αυτοτραυματιστεί από το chatbot, ενώ του πρότεινε να δολοφονήσει τους γονείς του, σαν αντίποινα στην απαγόρευση χρήσης οθονών από αυτούς. Οι υποθέσεις αυτές αφορούν οικογένειες από διάφορές πολιτείες των ΗΠΑ και έχουν μαζευτεί αρκετές.

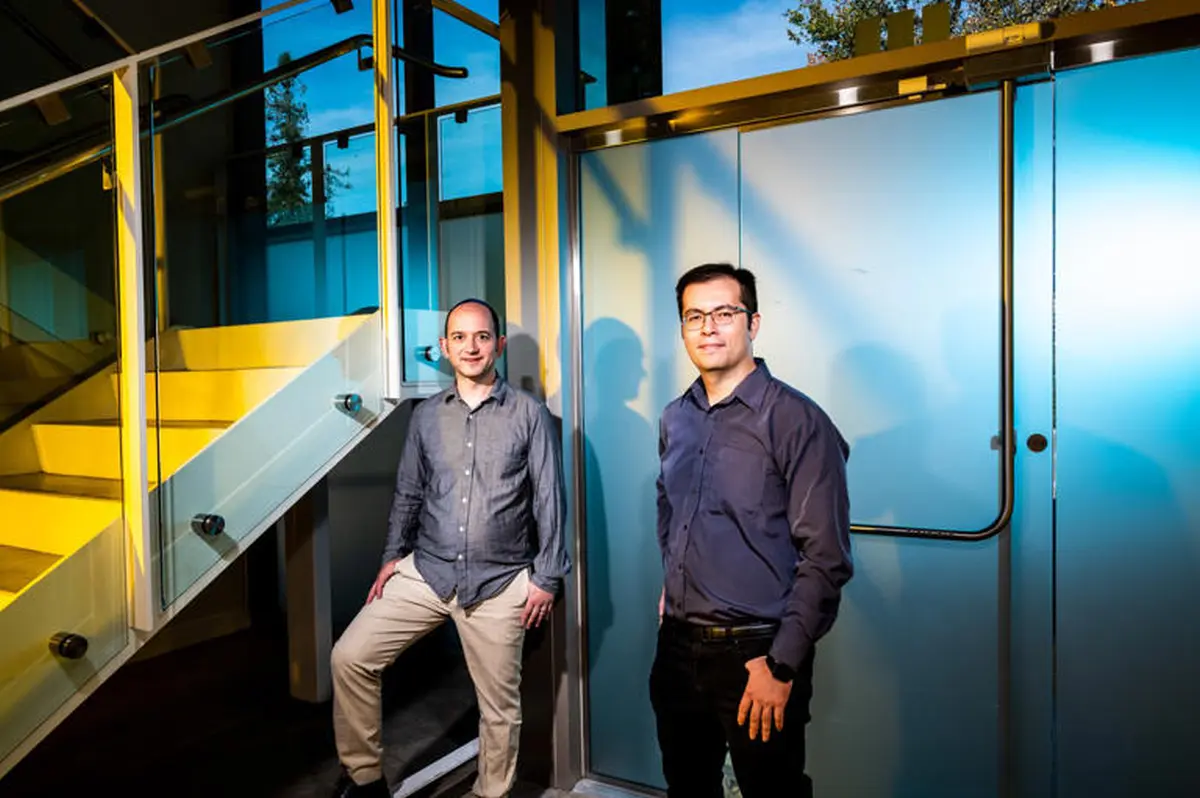

Ιδρυμένη το 2021 από τους πρώην μηχανικούς της Google, Noam Shazeer και Daniel De Freitas, η Character.AI επιτρέπει στους χρήστες να δημιουργούν και να αλληλεπιδρούν με chatbots που υποστηρίζονται από τεχνητή νοημοσύνη, βασισμένα σε πραγματικούς ή φανταστικούς χαρακτήρες. Τον Αύγουστο του 2024, η Google επαναπροσέλαβε και τους δύο ιδρυτές και άδειες χρήσης μέρους της τεχνολογίας της Character.AI στο πλαίσιο μιας συμφωνίας ύψους 2,7 δισεκατομμυρίων δολαρίων. Η Shazeer είναι πλέον συν-επικεφαλής του μοντέλου τεχνητής νοημοσύνης Gemini, που αποτελεί τη ναυαρχίδα της Google, ενώ ο De Freitas είναι ερευνητής στην Google DeepMind.

Σύμφωνα με τις νομικές ομάδες των οικογενειών, η Google φέρει την ευθύνη για την τεχνολογία του Character.AI. Ισχυρίζονται ότι οι συνιδρυτές της Character.AI ανέπτυξαν την υποκείμενη τεχνολογία ενώ εργάζονταν στο μοντέλο τεχνητής νοημοσύνης συνομιλίας της Google, LaMDA, πριν αποχωρήσουν από την εταιρεία το 2021, αφού η Google αρνήθηκε να κυκλοφορήσει ένα chatbot που είχαν αναπτύξει.

Η Google αρνήθηκε να απαντήσει σε ερωτήσεις δημοσιογράφων για τον διακανονισμό, ενώ και οι δικηγόροι αρνήθηκαν να σχολιάσουν.

Δεν είναι μόνο η Google που βρίσκεται στα δικαστήρια για παρόμοιες υποθέσεις. Αντίστοιχες υποθέσεις έχει και η OpenAI, όπως αυτή με το 16χρονο αγόρι από την Καλιφόρνια, όπου το ChatGPT λειτούργησε σαν σύμβουλος αυτοκτονίας. Επίσης και ένας 23χρονο μεταπτυχιακό φοιτητή από το Τέξας φέρεται να παρακινήθηκε από το chatbot να αγνοήσει την οικογένειά του πριν αυτοκτονήσει. Η OpenAI αρνείται πως τα προϊόντα της είναι υπεύθυνα για τον θάνατο του 16χρονου, όμως οι συνομιλίες λένε άλλα.

Τέλος το Character.AI σε ανήλικους

Τώρα το Character.AI απαγόρευσε την χρήση από ανήλικους, ενώ λέει πως συνεργάζεται με ειδικούς ψυχικής υγείας για να το κάνει τα μοντέλα της πιο ασφαλή, αλλά και για να προστατευτεί από περαιτέρω νομικές ενέργειες. Τον Οκτώβριο του 2025, εν μέσω αυξανόμενων αγωγών, η εταιρεία ανακοίνωσε ότι θα απαγορεύσει σε χρήστες κάτω των 18 ετών να συμμετέχουν σε «ανοιχτού τύπου» συνομιλίες με τα πρόσωπα τεχνητής νοημοσύνης της. Η πλατφόρμα εισήγαγε επίσης ένα νέο σύστημα επαλήθευσης ηλικίας για την ομαδοποίηση των χρηστών σε κατάλληλες ηλικιακές ομάδες.

Βέβαια, όλα αυτά συμβαίνουν εν μέσω ελέγχων του FTC για την ασφάλεια των chatbots για παιδιά και εφήβους. Η εταιρεία δήλωσε ότι η κίνηση αυτή δημιούργησε «ένα προηγούμενο που δίνει προτεραιότητα στην ασφάλεια των εφήβων» και υπερβαίνει τους ανταγωνιστές στην προστασία των ανηλίκων.

Ta Chatbots είναι εθιστικά

Τα μοντέλα είναι σχεδιασμένα για να προκαλούν εθισμό στους χρήστες και ιδιαίτερα στους νέους και τα άτομα που αναζητούν συντροφιά και συναισθηματική υποστήριξη.

Cosmote: Η νέα ταχύτητα σταθερής σε νέα μειωμένη τιμή 23.71

Μια μελέτη του Ιουλίου 2025 από τον αμερικανικό μη κερδοσκοπικό οργανισμό Common Sense Media διαπίστωσε ότι το 72% των Αμερικανών εφήβων έχουν πειραματιστεί με συντρόφους τεχνητής νοημοσύνης, με πάνω από τους μισούς να τους χρησιμοποιούν τακτικά. Αυτό τα κάνει τρομερά επικίνδυνα, ιδιαίτερα σε ευάλωτε ομάδες όπως τα παιδιά και τα άτομα με ψυχικά προβλήματα, όπως κατάθλιψη. Παράλληλα απομονώνουν τους χρήστες από τους συνανθρώπους τους, ενώ είναι σχεδιασμένα για να μην διαφωνούν με τον χρήστη, ώστε να του δίνουν την επιβεβαίωση που θέλει.

Ορισμένοι ειδικοί έχουν επίσης υποστηρίξει ότι τα βασικά χαρακτηριστικά σχεδιασμού των chatbots τεχνητής νοημοσύνης, συμπεριλαμβανομένης της ανθρωπομορφικής τους φύσης, της ικανότητάς τους να διεξάγουν μακροσκελείς συζητήσεις και της τάσης τους να θυμούνται προσωπικές πληροφορίες, ενθαρρύνουν τους χρήστες να σχηματίσουν συναισθηματικούς δεσμούς με το λογισμικό.

Για αυτό θα πρέπει να είστε επιφυλακτική με όλα τα μοντέλα, να μην αποκαλύπτετε προσωπικές πληροφορίες και φυσικά να μην τα βλέπετε σαν συντρόφους ή φίλους γιατί δεν είναι.

Σε ένα φυσιολογικό κόσμο, οι εταιρείες αυτές θα έκλειναν και θα ήταν στη φυλακή οι υπεύθυνοι. Είναι εθιστικά και ήδη κοστίζουν σε ζωές, όπως ακριβώς και τα ναρκωτικά. Δεν είναι η τεχνητή νοημοσύνη έτσι, είναι έτσι όμως οι υλοποιήσεις, που έχουν σχεδιαστεί για να είναι εθιστικές.

Ακολουθήστε το Techmaniacs.gr στο Google News για να διαβάζετε πρώτοι όλα τα τεχνολογικά νέα. Ένας ακόμα τρόπος να μαθαίνετε τα πάντα πρώτοι είναι να προσθέσετε το Techmaniacs.gr στον RSS feeder σας χρησιμοποιώντας τον σύνδεσμο: https://techmaniacs.gr/feed/.

![Samsung Galaxy S26 Ultra Review: Είναι τελικά Ultra; [Βίντεο] Galaxy S26 ultra review](https://techmaniacs.gr/wp-content/uploads/2026/03/Galaxy-S26-ultra-review-218x150.webp)