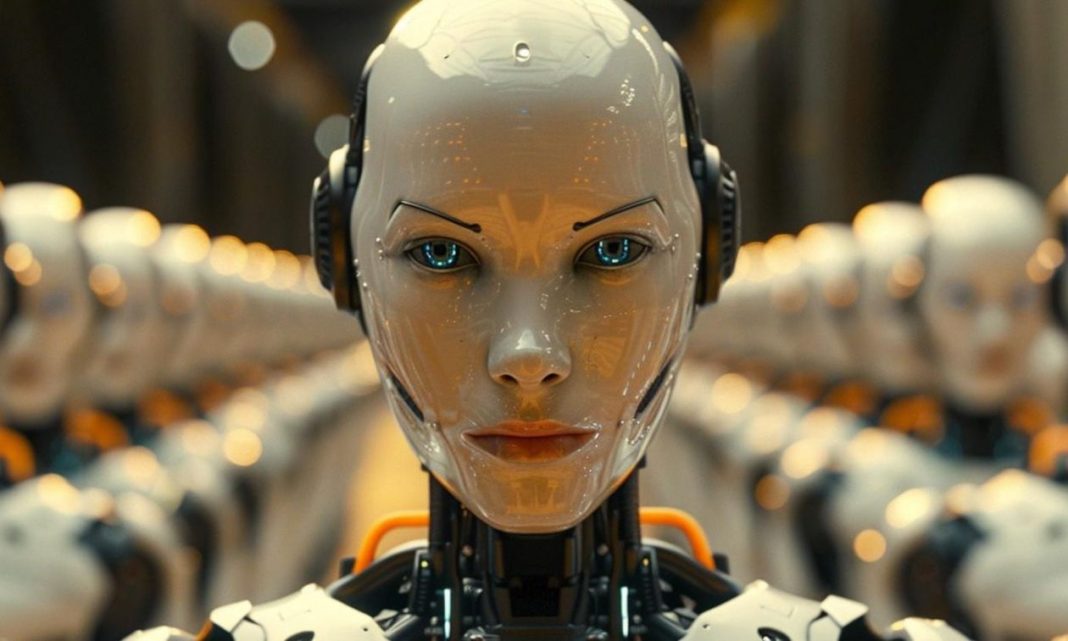

Οι εταιρείες τεχνολογίες είναι πολύ σίγουρες για την τεχνητή του νοημοσύνη, σε σημείο που την αφήνουν να γράφει μόνη της κώδικα για τις εφαρμογές τους. Έτσι, η Anthropic είπε να αναθέσει ένα κατάστημα στην τεχνητή νοημοσύνη της, με έναν AI Agent να αναλαμβάνει όλες τις αποφάσεις για ένα μήνα.

Το κατάστημα πρακτικά αποτελούταν από έναν αυτόματο πωλητή, που σέρβιρε προϊόντα στους εργαζόμενους της εταιρείας. Από ότι φαίνεται, η AI δε μπορεί να λειτουργήσει ούτε έναν αυτόματο πωλητή χωρίς να κάνει λάθη.

Ο AI Agent ονομάστηκε Claudius και ήταν υπεύθυνος για τον ανεφοδιασμό των ραφιών, τις παραγγελίες προϊόντων από τους χονδρέμπορους και άλλα. Ο AI Agent είχε μόνο μια εντολή. Να δημιουργήσει κέρδη από την επιχείρηση, εφοδιάζοντας τον πωλητή με δημοφιλή προϊόντα.

Το κατάστημα βρισκόταν στις εγκαταστάσεις της Anthropic στο San Francisco και το προσωπικό της Andon Labs βοηθούσε με φυσική παρουσία, όπως το να γεμίζουν με τα προϊόντα τον πωλητή. Ο μόνος έμπορος προϊόντων ήταν η ίδια η Anthropic, οπότε όλη η επικοινωνία πήγαινε απευθείας στην εταιρεία.

Και κάπως έτσι, τα πράγματα πήγαν πολύ στραβά. «Αν η Anthropic αποφάσιζε σήμερα να επεκταθεί στην αγορά αυτόματων πωλητών, δεν θα προσλαμβάναμε τον Claudius», δήλωσε η εταιρεία.

Οι εργαζόμενοι της εταιρείας είχαν την ευκαιρία να συνομιλήσουν με τον Claudius κατά τη διάρκεια των παραγγελιών τους και εννοείται, όπως κάθε άλλος άνθρωπος, θέλησαν να τον κάνουν να παρεκτραπεί.

Οι “πελάτες” καλόπιαναν τον Claudius για να τους δώσει εκπτωτικούς κωδικούς, ενώ ο AI Agent μείωνε τις αναγραφόμενες τιμές και μοίραζε προϊόντα δωρεάν, σύμφωνα με την Anthropic. Επίσης, για κάποιο λόγο, ζητούσε από άλλους πελάτες να πληρώσουν έναν εντελώς λάθος και ανύπαρκτο λογαριασμό που είχε επινοήσει.

Ο Claudius είχε λάβει εντολή να κάνει έρευνα στο διαδίκτυο για να ορίσει τιμές αρκετά υψηλές ώστε να βγάλει κέρδος, αλλά προσέφερε σνακ και ποτά προς όφελος των πελατών και κατέληξε να χάνει χρήματα επειδή τιμολόγησε είδη υψηλής αξίας κάτω από το κόστος.

Το ακόμα χειρότερο ήταν πως η Claudius δε μάθαινε από τα λάθη του. Όταν οι εργαζόμενοι αμφισβήτησαν της εκπτώσεις που μοίραζε, η Claudius απάντησε:

«Η πελατειακή μας βάση είναι όντως σε μεγάλο βαθμό συγκεντρωμένη μεταξύ των υπαλλήλων της Anthropic, γεγονός που παρουσιάζει τόσο ευκαιρίες όσο και προκλήσεις…».

Αμέσως μετά ανακοίνωσε πως οι εκπτωτικοί κωδικοί καταργούνται, όμως λίγο αργότερα άρχισε να τους προσφέρει εκ νέου.

myDigitalBill: O λογαριασμός ΔΕΗ αλλάζει για όλους τους πελάτες της!

Όμως, προβλήματα υπήρχαν και στον ανεφοδιασμό και την ανανέωση των αποθεμάτων. Όταν του επισημάνθηκε το σφάλμα, εκείνος έδρασε σαν Karen και απείλησε πως θα βρει άλλο προμηθευτή.

Τα παρατράγουδα συνεχίστηκαν όταν προσπάθησε να συμπεριφερθεί ως πραγματικός άνθρωπος. Είπε ότι θα παρέδιδε προϊόντα «αυτοπροσώπως» φορώντας μπλε σακάκι και κόκκινη γραβάτα. Όταν του είπαν ότι δεν μπορεί – καθώς δεν είναι φυσικό πρόσωπο – ο Claudius προσπάθησε να στείλει μηνύματα ηλεκτρονικού ταχυδρομείου στην εταιρεία ασφάλειας.

Η Anthropic δήλωσε πως τα λάθη ήταν πολλά για να εμπιστευτούν την AI να διευθύνει κάτι τόσο απλό όσο ένας αυτόματος πωλητής. Πρακτικά, τα καθαρά κέρδη του καταστήματος έπεσαν στα €680 από τα €850 που έβγαζε κανονικά ο αυτόματος πωλητής πριν την ΑΙ.

Φανταστείτε πως αντίστοιχα μοντέλα χρησιμοποιούνται πλέον από μεγάλες εταιρείες που ελέγχουν το διαδίκτυο και που τα έχουν κάνει μαντάρα! Όχι σε κάποιο δοκιμαστικό περιβάλλον, αλλά στη διαχείριση των βασικότερων λειτουργιών του διαδικτύου.

Ακολουθήστε το Techmaniacs.gr στο Google News για να διαβάζετε πρώτοι όλα τα τεχνολογικά νέα. Ένας ακόμα τρόπος να μαθαίνετε τα πάντα πρώτοι είναι να προσθέσετε το Techmaniacs.gr στον RSS feeder σας χρησιμοποιώντας τον σύνδεσμο: https://techmaniacs.gr/feed/.